Blog

Auteur du blog

Tous ses billets

Le texte vise à lutter contre la haine sur internet, mais son adoption est aussi l’occasion de rappeler que la haine est déjà visée en droit français. Le rédacteur de ces lignes est donc resté très interloqué quand quelques esprits peu au clair et invoquant la liberté d’expression se sont émus des contours supposés flous de la notion de haine.

Soulignons, dans le cadre de cette chronique qui parle aux gens du livre, que des textes légaux assez précis s’appliquent déjà aux éditeurs d’ouvrages de librairie (et à tout citoyen et organisation qui diffuse un message sur le territoire national).

Christchurch

Pour mieux comprendre, revenons en arrière à l’aide de quelques flash-backs. C’est, mercredi 15 mai 2019, qu’Emmanuel Macron a réuni à Paris le G7 des ministres du numérique afin de renforcer les lois pour bannir les contenus inappropriés des réseaux sociaux. Cette initiative a été lancée avec la première ministre Néo-Zélandaise, Jacinda Ardern, à la suite de l’attentat de Christchurch du 15 mars dernier. Si les États-Unis ne se sont pas, ces derniers temps, montrés très favorables à un tel accord au niveau mondial, de nombreux autres pays étrangers semblent prêts à s’impliquer. Les représentants de Facebook, Microsoft et Google étaient également présents. La preuve que le moment est venu de réagir, deux mois après la tuerie de Christchurch, largement partagée sur les réseaux sociaux avant que les hébergeurs ne fassent cesser cette macabre diffusion.

Le vendredi 10 mai 2019, Emmanuel Macron a reçu Marc Zuckerberg, P-DG de Facebook, pour débattre de la lutte contre la haine en ligne et de la manière d’empêcher la propagation des discours extrémistes.

Le 30 mars, dans une tribune publiée dans le Washington Post (propriété de Jeff Bezos, patron d'Amazon), le P-DG de Facebook se disait favorable à un rôle plus actif de la part des gouvernements « afin de préserver le meilleur d’internet – la liberté de s’exprimer et la possibilité pour les entrepreneurs d’innover- tout en protégeant la société contre certains maux, comme les discours haineux ».

Modération

Un rapport publié le vendredi 10 mai 2019 tire les conclusions de l’immersion pendant plusieurs mois d’experts français dans les arcanes de Facebook (en France et à l’étranger). Ce test avait été décidé par Emmanuel Macron et Mark Zuckerberg il y a un an. Le rapport souligne l’insuffisance des mécanismes de modération et le manque de transparence du fonctionnement des plateformes, justifiant une intervention des pouvoirs publics.

Le rapport recommande entre autres de fixer des « obligations de moyens » aux principales plateformes mondiales (sur le modèle de régulation imposé aux banques). La mise en œuvre serait confiée à une autorité administrative indépendante, probablement le CSA, qui aurait notamment un droit de regard sur les algorithmes utilisés par Facebook et Twitter.

Dans un rapport publié récemment, Facebook a reconnu des « erreurs de modération » et mentionne le nombre de contenus rétablis après avoir été l’objet d’une analyse défaillante. A titre d’exemple, dans la catégorie « Nudité adulte et sexualité », Facebook a rétabli 452000 contenus qui avaient, dans un premier temps, fait l’objet d’une suppression entre janvier et mars 2019. Ce chiffre représente 2,3% des publications de cette catégorie sur la période.

Au sein de Facebook, la modération repose à la fois sur un contrôle humain (environ 15000 personnes dans le monde), mais aussi sur une détection automatique via des algorithmes d’intelligence artificielle. Malheureusement, ces derniers ne sont pas toujours efficaces, et c’est bien tout le problème.

Facebook a annoncé début juillet 2019 sa participation active à la future loi française.

Au rapport

Conscient de la nécessité de réagir par la voie législative, le Premier ministre avait confié, l’an passé, à la députée Laetitia Avia, à l’écrivain Karim Amellal et au vice-président du CRIF Gil Taieb la rédaction d’un rapport consacré au renforcement de la lutte contre le racisme et l’antisémitisme sur Internet. Ce rapport a été remis au Premier ministre le 20 septembre 2018. Ancré dans le Plan national de lutte contre le racisme et l’antisémitisme 2018-2020, il entend répondre à la prolifération des contenus haineux par des propositions concrètes et conformes à la liberté d’expression. Le rapport proposait notamment de responsabiliser les plateformes et de créer une procédure de signalement uniformisée et clairement identifiable. J’avais été auditionné par cette équipe intelligente et motivée.

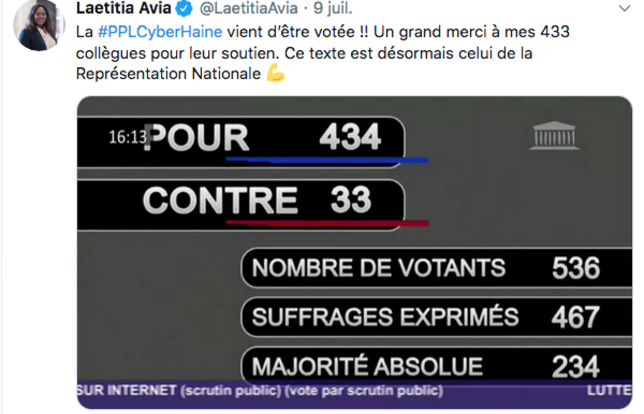

Il s’agissait là de la première pierre à l’édifice voulu par le Président de la République afin de lutter contre la haine sur les réseaux sociaux. Aussi, le choix de Laetitia Avia comme rapporteure du texte déposé en mars à l’Assemblée nationale s’imposait.

La proposition de loi du 20 mars 2019 visant à lutter contre la haine sur internet a déjà fait l’objet de nombreuses critiques, parfois justifiées.

Suppression

Le point le plus critiqué est la création d’une obligation de suppression des contenus haineux. Les opérateurs devront, dans un délai de 24 heures après la notification d’un contenu, retirer ou rendre inaccessible ce contenu, dès lors qu’il comporte manifestement une incitation à la haine ou une injure discriminatoire à raison de la race, de la religion, du sexe ou de l’orientation sexuelle.

L’article 24 de la loi de 1881 sur la liberté de la presse vise déjà les provocations « à la discrimination, à la haine ou à la violence à l’égard d’une personne ou d’un groupe de personnes à raison de leur origine ou de leur appartenance ou de leur non-appartenance à une ethnie, une nation, une race ou une religion déterminée », que ces provocations soient suivies d’effet ou non.

Evoquons aussi la loi du 16 juillet 1949 sur les publications destinées à la jeunesse, dont l’article 2, réformé en 2011, dispose que les publications visées ne doivent pas comporter de contenus « présentant un danger pour la jeunesse en raison de leur caractère pornographique ou lorsqu'il est susceptible d'inciter à la discrimination ou à la haine contre une personne déterminée ou un groupe de personnes, aux atteintes à la dignité humaine, à l'usage, à la détention ou au trafic de stupéfiants ou de substances psychotropes, à la violence ou à tous actes qualifiés de crimes ou de délits ou de nature à nuire à l'épanouissement physique, mental ou moral de l'enfance ou la jeunesse. »

Les opérateurs ont désormais une obligation de création d’un dispositif permettant, pour l’utilisateur à l’origine du contenu litigieux, de contester le retrait de celui-ci.

En contrepartie, l’utilisateur à l’origine du signalement peut contester l’absence de retrait. La sanction est dissuasive : l’opérateur qui ne respecterait pas l’obligation de création d’un tel dispositif s’exposerait à une sanction financière, déterminée et prononcée par le Conseil Supérieur de l’Audiovisuel, pouvant atteindre 4% de son chiffre d’affaires mondial annuel.

Censure

Si cette proposition a fait grincer des dents les spécialistes de la liberté d’expression sur les réseaux sociaux, c’est que le risque judiciaire qui pèse sur les opérateurs de plateforme sera vraisemblablement à l’origine de nombreux retraits injustifiés, puisque la notion de contenu comprenant « manifestement » une incitation à la haine ou une injure discriminatoire reste indéfinie. A l’inverse, un retrait de contenu licite provoquerait un risque moins important pour la plateforme. Une forme de censure pourrait ainsi devenir la norme dès qu’un signalement interviendrait. Mais nous n’y sommes pas encore.

Enfin, la définition du « seuil » de tolérance doit également faire l’objet de beaucoup de précautions. Un seuil trop élevé peut provoquer un déplacement des discours de haine vers des plateformes moins utilisées, et un seuil trop bas peut faire peser une charge bien trop lourde sur des structures mal adaptées.

Parmi les autres dispositions, se trouve la simplification de la notification des contenus haineux, la création d’une obligation de représentation légale en France (dans le but d’exercer les fonctions d’interlocuteur référent pour l’application de la présente loi), un alourdissement des sanctions encourues par les plateformes en cas de manquement à leurs obligations de coopération (en multipliant par trois l’amende actuellement d’un montant de 75 000 euros), et des injonctions de blocage d’accès et de déréférencement aux sites illicites.

Après un récent avis du Conseil d’État, et une nouvelle visite de Marc Zuckerberg à Paris, Laetitia Avia a reconnu que des modifications étaient prévues. Un délit pénal de non-retrait des contenus et l’extension du champ d’application du texte aux moteurs de recherche comme Google ou Bing ont été envisagés. Le P-DG de Facebook demandait la renonciation au délai de vingt-quatre heures pour le retrait des contenus haineux « manifestement illicites » pour se focaliser sur le fait d’empêcher la propagation d’un contenu par son partage. Pour autant, cette disposition ne sera pas retirée de la proposition de loi, dont elle est d’ailleurs un des points centraux.

Liberté d'expression

Pour ce qui est du délit pénal de non-retrait des contenus, il vise le représentant légal français que les plateformes devront nommer. La loi prévoit également la création d’un parquet spécialisé. Enfin, la députée LREM a envisagé des peines d’interdiction temporaire de consultation des réseaux sociaux pour les auteurs de contenus haineux. Si cette dernière proposition pouvait sembler alléchante pour lutter contre la récidive, on ne peut que s’interroger sur sa possible mise en application et le risque d’atteinte à la liberté d’expression.

Le Conseil Supérieur de l’Audiovisuel s’est déclaré favorable à un mécanisme de sanctions contre les plateformes en ligne, mais le Conseil National du Numérique a exprimé ses inquiétudes. Ce dernier s’interroge notamment sur la protection qui sera désormais accordée à la liberté d’expression. Il insiste sur la nécessité de bien définir les termes et les contenus ainsi que de prévoir des recours effectifs.

Enfin, une consultation citoyenne était ouverte en ligne jusqu’au 12 mai à propos de la haine sur internet.

La loi Avia s’inspire d’une loi allemande, la loi NetzDG, qui, depuis le 1er janvier 2018 impose une mesure similaire aux plateformes comptant au moins deux millions d’utilisateurs. La même critique est faite à la loi allemande et à la proposition de loi Avia : le risque que les responsables des plateformes, paniqués à l’idée d’avoir à payer de lourdes amendes, retirent tous les contenus signalés, y compris ceux qui ne seraient pas clairement illicites. Plus d’un an après l’entrée en vigueur de la loi, le bilan est très en demi-teinte : Facebook, Twitter ou YouTube n’ont presque rien retenu. Les demandes ont bien été traitées dans les 24h, comme l’exigeait la loi, mais à 80% elles étaient rejetées. Cependant, le Gouvernement allemand veut laisser le temps à cette loi de faire ses preuves.

Trois semaines après la tuerie de Christchurch, l’Australie a, quant à elle, fait voter une loi très répressive contre les réseaux sociaux : s’ils ne suppriment pas assez rapidement les contenus violents liés à des « actes terroristes » (notamment), ils devront payer une amende correspondant à 10% de leur chiffre d’affaire annuel. Les dirigeants de ces entreprises risquent jusqu’à trois ans de prison en cas de manquement. La force de cette réponse législative n’a d’égale que le traumatisme subi par tout un pays.

Il était temps que la France républicaine s’empare à son tour de la lutte concrète contre les dérives antisémites, racistes, sexistes et homophobes.

Auteur du blog

Emmanuel Pierrat

Tous ses billets- Réseaux sociaux

- Censure

- Liberté d'expression

- Discrimination

- Politique

- Mark Zuckerberg

- Assemblée nationale

Articles liés

La haine et la loi

Facebook et la nudité

Des posts Facebook de la rédactrice en chef du BBF choquent la communauté des bibliothécaires

Les dernières

actualités

Reportage

Dans les coulisses de la sélection du prix Sirène-Lapérouse 2026

Le jury du prix Sirène-Lapérouse s'est réuni le 19 mars au restaurant Lapérouse, à Paris, pour établir la liste des recueils de poésie qui composent la sélection finale de sa deuxième édition. Livres Hebdo a assisté aux délibérations.

Par Lora Lemaréchal

Proclamation

Pascal Boroto est récompensé pour Le Nom de ma mère (JC Lattès). Il a reçu son prix à Kinshasa en présence du président du jury Mohamed Mbougar Sarr et de la directrice générale de JC Lattès Véronique Cardi.

Par Charles Knappek

Édition

Québec : La Pastèque rejoint Bayard Canada pour se développer en France

La maison d'édition québécoise La Pastèque, spécialisée en BD et jeunesse, a été rachetée par le groupe Bayard Canada. Annoncée en début de semaine, l'opération vise à pérenniser la maison et à renforcer sa présence sur le marché français.

Par Anatole Lanneau

Abonnez-vous à Livres Hebdo

- Accès illimité au site

- LH Meilleures Ventes, tous les indicateurs métiers

- LH le Magazine, le mensuel

- LH Spécial, le thématique

- Les bibliographies : Livres du Mois et Livres de la Semaine

Également disponibles sur notre boutique :

Numéros à l'unité, hors-séries, annuaire et planisphère.